科技创新

专家要求全面禁止“杀手机器人”

多个国家的著名学者和企业家发表公开信,要求摒弃俗称的“杀手机器人”。宇宙学家霍金等近2000名签名者担心,此类战斗机器不久就会问世。

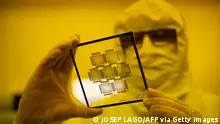

(德国之声中文网)在人迹罕至的地方跋涉自如的机器人、根据预入信息自行作出决定的电脑,都已出现。下一个出现的将是能自行杀人的机器人?科学家和技术专家们所担心的正是这么一种自动武器:具备人工智能、无需人类干预、自主选择攻击目标的机器人。

近2000名专家日前签署并发表一份公开信,要求禁止“杀手机器人”。

“不出几年,就会出现”

签名者多为研究人员、电脑专家和居领先地位的互联网企业成员,其中包括英国天文物理学家霍金(Stephen Hawking)、苹果公司联合创办人沃兹尼亚克(Steve Wozniak)、诺贝尔物理学奖得主韦尔切克(Frank Wilczek)、语言学家乔姆斯基(Noam Chomsky)和开发电动汽车的特斯拉(Tesla)公司执行官、硅谷明星穆斯克(Elon Musk)。

公开信指出,鉴于人工智能的长足发展,电影“终结者”里那样的战争机器将不是在数十年后,而是在数年内就有可能成为现实。此信在布伊诺斯艾利斯国际人工智能大会之际发表。公开信指出,按照既定标准自行杀人的无人机近期就会问世。签名者同时强调,他们并不反对像美国在打击涉嫌恐怖份子斗争中所投入的那种受人遥控的武装无人机。

“第三次战争革命”

签名者在公开信中指出,风险因素非常高,因为,在黑火药和核弹之后,人工智能武器可能会成为“第三次战争革命”。他们警告说,一旦某军事强国率先装备杀手机器人,在该领域的全球性军备竞赛便难以避免。与核武器不同的是,杀手机器人既不昂贵,又不需要稀缺原料。至人工智能武器在黑市上出现或落入恐怖份子和独裁者之手,只是时间问题。公开信强调,“今天,对人类而言,一个核心问题是,它是要启动还是要阻止开发此类武器的全球军备竞赛”。

能够自行寻找被杀对象的机器人适合有目标谋杀行动。 公开信指出,这样的自动武器是破坏国家稳定、奴役人类、以及有选择性灭绝某个民族的理想工具。公开信要求“全面禁止没有严格人类控制的攻击性自动武器系统”。

德国签名人中包括慕尼黑德国国防军大学教授绍尔(Frank Sauer)以及其它高校及马克斯·普朗克研究所的工作人员。

凝炼/洪沙(德新社/法新社)